GazeboにおけるTurtleBot3を用いたLiDAR迷路探索アルゴリズムの実装と検証

本記事では、ロボットシミュレータGazebo環境下において、TurtleBot3(Burgerモデル)を用いた自律的な迷路探索システムの開発プロセスについて報告します。LiDARセンサーを活用した障害物回避および経路決定のロジックを実装し、その挙動を検証しました。

開発の背景と目的

自律移動ロボットにおける未知環境の探索は、ロボティクスの基礎的かつ重要な課題です。本プロジェクトでは、安価で汎用性の高いLiDARセンサーのみを用いて、外部からの指示なしに迷路を走破するアルゴリズムの構築を目的としました。

2. システム構成

検証には以下の環境およびハードウェア構成を使用しています。

- OS: Ubuntu 22.04 LTS

- Middleware: ROS 2 Humble

- Simulator: Gazebo 11

- Robot: TurtleBot3 Burger

- Sensor: LDS-01(360° LiDAR)

TurtleBot3 Burgerについて

TurtleBot3は、ROBOTIS社が展開するオープンソースのロボットプラットフォームで、ROS(Robot Operating System)学習のデファクトスタンダードとなっています。中でも「Burger」モデルは、2輪差動駆動方式を採用したコンパクトなタワー型構造が特徴です。360度の計測が可能なLiDARセンサー(LDS-01)と制御ボード(OpenCR)を標準搭載しており、SLAM(自己位置推定と地図作成)や自律走行のプロトタイピングに最適な機体です。

アルゴリズムの実装

迷路探索のロジックとして、LiDARの走査データを5つの主要なサンプリング領域(左、左前方、前方、右前方、右)に分割し、それぞれの距離情報に基づいて線速度および角速度を動的に制御するフィードバックループを実装しました。

走査データのセグメンテーション

前方15度の範囲を衝突防止用のクリティカルエリアとし、左右のサイドエリアの距離差を利用して壁との並行性を維持する手法を採用しています。

# 制御ロジックの概要

def get_action(lidar_ranges):

if lidar_ranges['front'] < threshold_dist:

# 前方に障害物を確認

if lidar_ranges['left'] > lidar_ranges['right']:

return turn_left()

else:

return turn_right()

else:

# 直進および微調整

return go_straight_with_alignment()

実験結果の分析

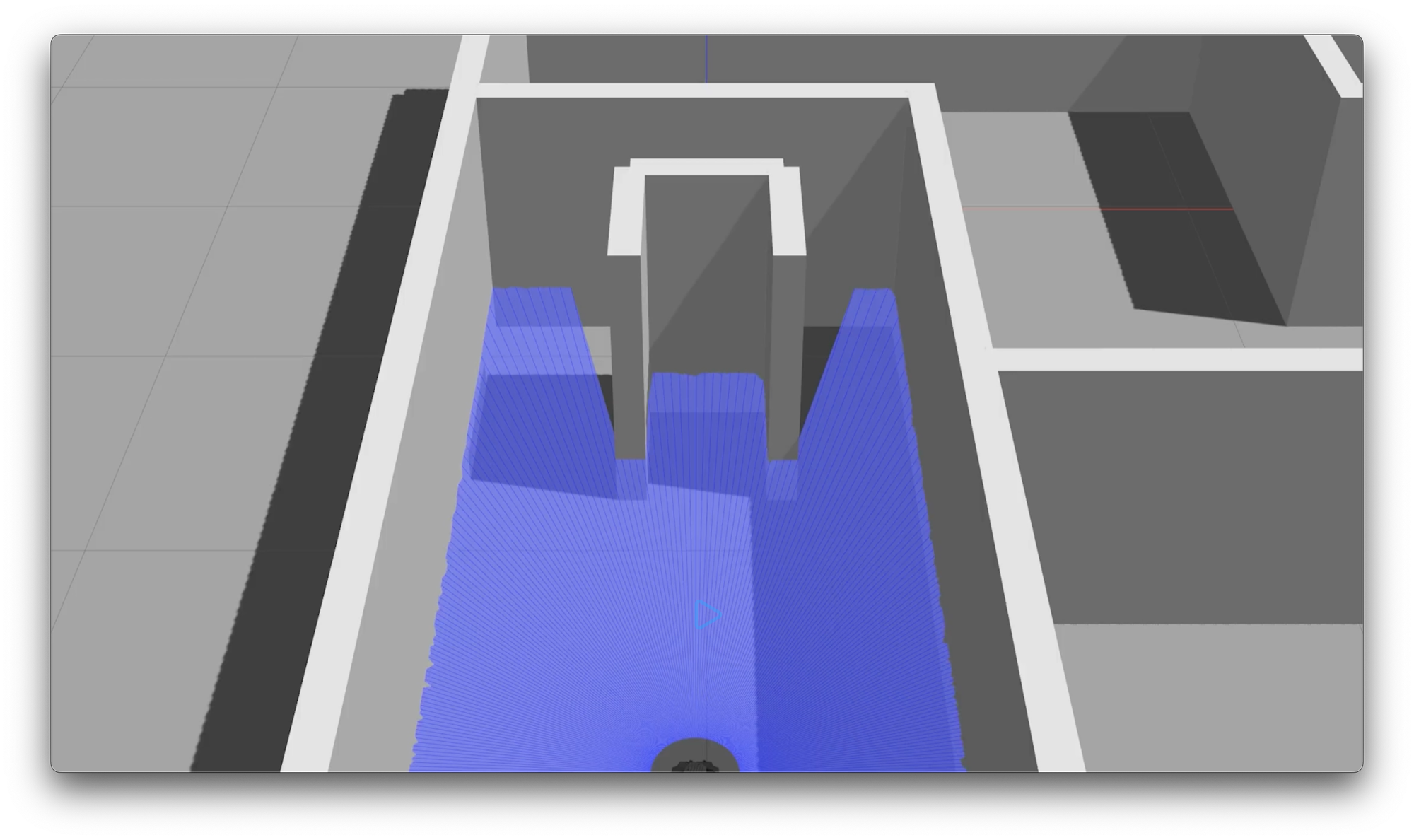

実験は、複数のクランクと行き止まりを含むテスト用迷路で実施されました。Burgerは実装されたアルゴリズムに従い、壁面との一定距離を保ちながら安定した走行を維持。狭隘な通路においても、LiDARのサンプリング周期に同期した正確な旋回挙動を確認することができました。

最終検証と総括

全てのチェックポイントを通過し、最終段階である迷路出口付近までの到達を確認しました。

動画の1分20秒付近、迷路の出口となる広場を前方に捉えた場面において、センサーの最大検知レンジを超える空間が広がった結果、アルゴリズムはこれを「前方走行不能な未知の領域」と判定。

ゴールを目前にして完璧な180度旋回を行い、再び迷路の深部へと帰還していく様子が記録されています。プログラム上のロジックに忠実な挙動ではありますが、運用上の課題が浮き彫りとなる結果となりました。

現場からは以上です!

「Generative AI & ML」の関連記事

画像1枚から3Dを作る技術 - Zero123からUnique3Dまでの進化の過程を解説

たった1枚の画像から3Dモデルを生み出す魔法のようなAI技術「Generative 3D」。Zero123から最新のUnique3Dに至るまでの革命的な進化の歴史と、その裏側にある仕組みを分かりやすく解説します。

ローカルLLM比較の最短経路:なぜ開発者は「Ollama + Open WebUI」ではなく「LM Studio」を選ぶべきなのか

ローカルLLM環境の構築、まだ「インフラ構築ごっこ」に時間を溶かしていませんか?Ollama + Open WebUIの定番構成と、開発者向け特化の「LM Studio」を徹底比較。モデル検証の最短経路を解説します。

【生成AI×UIデザイン】一貫性のあるアイコンをLoRAで安定生成する技術検証

画像生成AIが陥りがちな「描き込みすぎ」や「一貫性の不在」を防ぎ、UI/UXデザインに最適なシンプルなアイコンをLoRAを用いて安定生成するアプローチを解説します。